AI

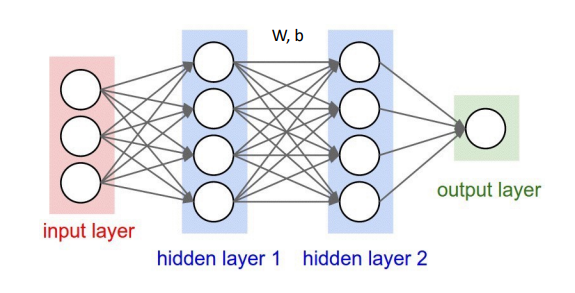

심층신경망(Deep Neural Network(DNN))

✿(๑❛ڡ❛๑)✿

2022. 10. 5. 00:33

728x90

SMALL

perceptron : 은닉레이어가 하나인 신경망 구조

preceptron은 logistic regression unit 으로 구성될 수 있음

-> 하나의 logistic unit으로는 XOR문제를 해결 할 수 없음.

->여러개의 logistic units으로는 XOR문제 해결가능!

hidden layer이 2개 이상이면 MLP

Marvin Minsky : 학습이라는 방법으로는 w,b 알아낼 수 없을 것(너무 복잡함)

H(x)는 두개의 linear regression unit으로 되어있음

MLP의 H(x)=sigmoid(sigmid(x*w1+b1)*w2+b2)

--> w1, w2, b1, b2 값 어떻게 구할까?

GD: 하나일때는 단순하지만 MLP는 GD를 적용하기에는 너무 복잡함.

-> Backpropagation

1) W,b 초기화

2)Forward 계산 &Error 측정

3)Error 값을 Backward하면서 w,b 업데이트

이미 초기화된 w,b forward-> predictiond y(dog)와 실제 정답사이의 error 계산-> backward : error이 작아지는 방향으로 w,b 업데이트

w와 b 갱신되는 방향= 에러를 최소화하는 방향

728x90

LIST